En bref

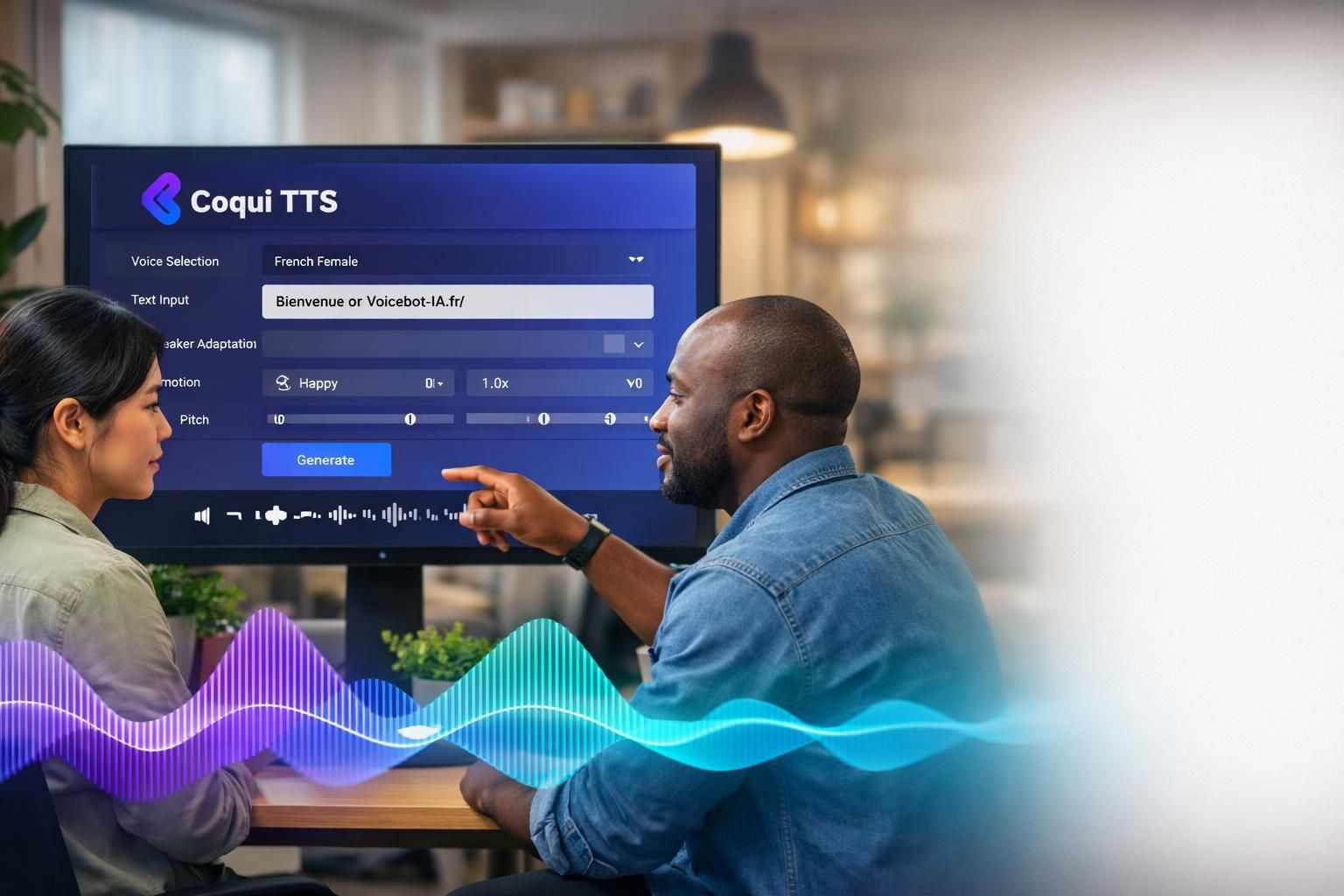

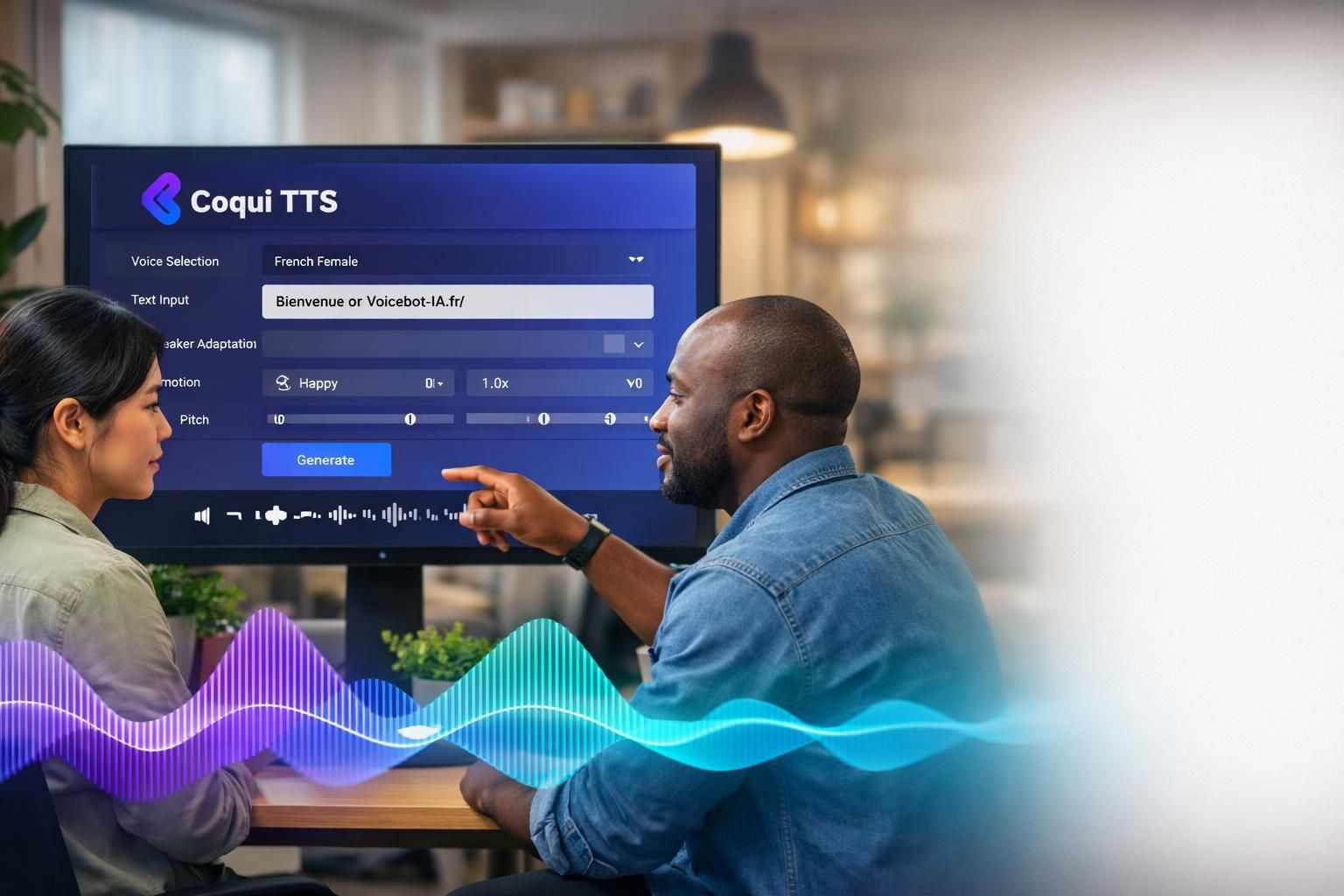

- Coqui TTS est une boîte à outils open source de synthèse vocale (text-to-speech) pensée pour les usages sérieux, du prototype au déploiement.

- Son atout majeur : une approche local-first qui facilite la confidentialité, le contrôle des données et l’intégration dans des projets personnalisés.

- Vous profitez d’un écosystème riche : modèles vocaux pré-entraînés, clonage de voix, temps réel, entraînement et affinage.

- La mise en place peut être très simple (pip, CLI), ou très avancée (fine-tuning, serveur, Docker) selon vos objectifs.

- La réussite dépend moins de “l’IA” que de la qualité de vos données audio, de vos exigences légales et de votre stratégie produit.

Coqui TTS s’est imposé comme un choix crédible quand vous voulez une voix synthétique maîtrisée, sans dépendre d’un service distant. Le sujet n’est plus seulement de “faire parler une machine”, mais de produire une parole utile : intelligible, stable, cohérente avec votre marque, et intégrable dans une architecture moderne. Pour un média, c’est la promesse d’articles écoutables. Pour un service client, c’est l’opportunité d’un agent vocal qui s’exprime de façon naturelle. Pour une équipe produit, c’est la possibilité de tester vite, d’itérer, puis de durcir en production.

Ce qui rend l’approche séduisante en 2026, c’est l’équilibre : d’un côté, une brique de logiciel libre qui s’appuie sur l’apprentissage profond via Python et PyTorch ; de l’autre, une communauté et des modèles prêts à l’emploi, dont des références comme XTTS v2. Vous pouvez démarrer “out-of-the-box”, puis pousser très loin la personnalisation. Et lorsque votre cas d’usage devient sensible (données vocales, conformité, identité sonore), le fait de garder la main change tout.

Coqui TTS et la synthèse vocale open source : ce que vous achetez vraiment (sans licence)

Adopter Coqui TTS pour un projet de synthèse vocale, ce n’est pas “installer un paquet Python” et espérer un miracle. C’est choisir une stratégie : privilégier le contrôle, la transparence et l’industrialisation sur mesure. Dans les faits, vous obtenez une boîte à outils de text-to-speech construite pour l’intelligence artificielle moderne, où chaque brique peut être remplacée, ajustée, ou optimisée.

Le point de bascule est souvent le même : au début, une équipe veut simplement convertir du texte en audio. Puis arrivent les questions qui comptent : comment garder une voix cohérente sur 300 pages ? Comment produire à grande échelle sans exploser les coûts ? Comment éviter que les données (scripts, dialogues, enregistrements) sortent de l’entreprise ? À ce moment-là, l’open source cesse d’être une posture et devient une assurance opérationnelle.

Une bibliothèque validée par la recherche… et testée par la réalité

Coqui TTS a hérité d’un ADN très “recherche appliquée”. On y retrouve des architectures connues (Tacotron2, VITS, FastSpeech, Glow-TTS) et des vocodeurs capables de produire une forme d’onde convaincante (HiFiGAN, MelGAN, WaveRNN, ParallelWaveGAN, UnivNet). Concrètement, cela signifie que vous pouvez choisir le compromis qui vous ressemble : latence, expressivité, stabilité, simplicité d’entraînement.

Pour comprendre l’étendue des possibilités, la documentation officielle reste une base solide : documentation Coqui TTS. Elle clarifie la logique de configuration, les modèles, et les modes de déploiement. Cette clarté a un effet immédiat : vos prototypes ne restent pas des prototypes.

Le tournant “local-first” : confidentialité, coûts, pérennité

Lorsqu’un projet vocal devient stratégique, les contraintes se durcissent. Un cabinet médical, par exemple, ne veut pas que des transcriptions ou des intentions d’appel se retrouvent dans un outil externe. Une banque veut maîtriser ses flux et tracer les traitements. Une PME veut éviter le piège des quotas et de la facturation à la requête. Avec une solution locale, vous pouvez arbitrer : CPU pour des volumes modestes, GPU pour de la production intensive, et serveur interne pour absorber plusieurs demandes.

À ce stade, il est utile de distinguer deux notions : le code (souvent permissif) et les modèles vocaux (dont les licences peuvent varier). Cette nuance n’est pas un détail juridique : elle conditionne ce que vous pouvez commercialiser, redistribuer ou intégrer. Une bonne pratique : lire la “model card” avant de basculer un cas d’usage en production.

Vous souhaitez mettre en place un voicebot ?

AirAgent propose une solution française clé en main →

Un dernier point renforce l’intérêt : le projet a connu des phases historiques (scission d’un projet plus ancien, évolution communautaire), mais l’essentiel est là en 2026 : l’écosystème avance, les forks actifs existent, et les intégrations se multiplient. Ce pragmatisme technique prépare naturellement la question suivante : comment le moteur fonctionne-t-il, concrètement, du texte jusqu’au WAV ?

Comment fonctionne un moteur text-to-speech avec apprentissage profond : du texte à la voix synthétique

Le cœur de Coqui TTS repose sur une idée simple à énoncer, mais exigeante à réussir : transformer du texte en une parole naturelle, avec rythme, intonation, et prononciation. En pratique, l’apprentissage profond orchestre plusieurs étapes. Vous n’obtenez pas “un son”, vous obtenez une prosodie, une diction, un timbre, et une cohérence acoustique. C’est exactement ce qui fait la différence entre un audio “robotique” et une voix synthétique crédible.

Le flux de traitement : la chaîne qui explique tout

Un flux typique suit une progression structurée : entrée textuelle, normalisation linguistique, génération d’un spectrogramme, puis conversion en onde audio via un vocodeur. Coqui TTS formalise bien cette chaîne, ce qui vous aide à diagnostiquer vos problèmes. Si la voix “mange” des mots, ce n’est pas forcément le vocodeur. Si l’intonation est étrange, ce n’est pas forcément le texte. Chaque brique a sa signature.

Dans les architectures modernes, le modèle TTS produit souvent une représentation intermédiaire (spectrogramme mel), puis un vocodeur (HiFiGAN, par exemple) reconstruit la forme d’onde finale. Cette séparation vous donne un levier : vous pouvez améliorer la qualité sans changer tout le pipeline, en remplaçant uniquement le vocodeur, ou en ajustant ses paramètres.

Temps réel, traitement par lots : deux logiques de production

Beaucoup d’équipes découvrent trop tard que “générer un fichier audio” et “servir de l’audio en direct” ne sont pas le même métier. Pour des usages temps réel (assistant vocal, callbot), la latence est décisive. Les configurations modernes visent des latences très basses, parfois sous les 200 ms en streaming selon la charge, le matériel et le modèle. Pour des usages batch (livres audio, podcasts d’articles), la vitesse globale prime : on veut générer 10 heures d’audio sans surveillance, avec une qualité stable.

Le bon réflexe consiste à définir votre contrainte dominante : latence, coût, ou expressivité. Ensuite seulement, vous choisissez la famille de modèles et l’environnement d’exécution.

Voix et identité : speaker encoder, multi-locuteurs et clonage

Le “truc” qui impressionne le plus vos parties prenantes, c’est le clonage de voix. Mais ce qui compte le plus en production, c’est la reproductibilité. Coqui TTS embarque des mécanismes de représentation du locuteur (speaker encoder) et des approches multi-locuteurs. Le résultat : vous pouvez conditionner la génération sur un échantillon, ou choisir un profil de locuteur, selon les modèles disponibles.

Pour une équipe produit, cela ouvre un champ clair : une voix “marque” pour les contenus, une voix “support” plus neutre pour la relation client, et des variations par langue si vous opérez à l’international. Et si vous devez comparer des fiches synthétiques et des présentations, des pages comme présentation Coqui sur AiPure peuvent aider à cadrer les fonctionnalités sans entrer tout de suite dans le code.

Une fois le fonctionnement compris, la mise en œuvre devient plus rationnelle. La section suivante aborde le concret : installation, choix de version, commandes utiles, et un premier script qui produit un WAV exploitable.

Vous hésitez entre une approche 100% sur mesure et une solution prête à déployer ?

Comparer un déploiement rapide avec AirAgent →

Installer Coqui TTS et démarrer vite sur des projets personnalisés : pip, GitHub, Docker, CLI

La force de Coqui TTS, c’est sa capacité à vous laisser choisir votre niveau d’engagement. Vous pouvez démarrer en “consommateur” de modèles (inférence), ou vous positionner en “constructeur” (entraînement, fine-tuning, serveurs). Pour des projets personnalisés, cette progressivité est précieuse : vous prouvez la valeur rapidement, puis vous renforcez la maîtrise technique quand le ROI se confirme.

Les chemins d’installation : simple, complet, ou reproductible

Pour l’inférence, l’installation via PyPI est souvent suffisante. Le package communautaire est consultable ici : fiche PyPI de coqui-tts. Si votre objectif est de contribuer, d’accéder à des notebooks, ou de maîtriser les dépendances à un niveau fin, la source reste la meilleure option : dépôt GitHub Coqui TTS.

Enfin, pour un environnement stable et reproductible (tests, démos internes, mise en production containerisée), Docker simplifie la vie. Cela réduit le temps perdu sur les erreurs de compilation ou les dépendances système, surtout quand l’équipe tourne entre macOS, Windows et Linux.

Un scénario concret : la PME “Alphacall” qui veut une voix pour son standard

Imaginez Alphacall, une PME de services qui reçoit 400 appels par jour. L’équipe veut un agent vocal pour annoncer les horaires, orienter les demandes, et lire des informations simples, sans dépendre d’un cloud externe. Première étape : produire une voix acceptable sur un poste de dev. Deuxième étape : packager un microservice interne. Troisième étape : brancher le tout sur le système téléphonique.

Avec Coqui TTS, Alphacall commence par le modèle XTTS v2, car il combine multilingue et capacité de clonage. Elle génère un WAV test, puis l’intègre dans une maquette. L’effet est immédiat : les décideurs n’évaluent plus “une techno”, ils évaluent une expérience utilisateur.

Checklist de démarrage : ce qui évite 80% des blocages

- Fixer la version de Python (souvent 3.10 ou 3.11) et isoler l’environnement (venv) pour éviter les conflits.

- Valider l’audio de référence : mono, volume stable, bruit de fond minimal, durée courte mais propre pour le clonage.

- Tester CPU puis GPU : d’abord la reproductibilité, ensuite la performance.

- Commencer en CLI pour vérifier rapidement modèles et sorties avant d’industrialiser l’API Python.

- Documenter les licences : code vs modèles, et conditions d’usage commercial si nécessaire.

Tableau d’aide à la décision : quel mode de déploiement pour quel objectif ?

| Option | Quand la choisir | Avantages | Points d’attention |

|---|---|---|---|

| Installation PyPI (inférence) | Prototype rapide, POC, tests qualité | Simple, rapide, peu de friction | Moins adapté si vous devez modifier le cœur du moteur |

| Source via GitHub | Personnalisation avancée, contributions, notebooks | Contrôle fin, possibilité d’extensions | Dépendances plus exigeantes, maintenance interne |

| Docker / serveur interne | Industrialisation, environnement reproductible | Déploiement propre, scaling, séparation des rôles | Nécessite une stratégie d’observabilité (logs, métriques) |

| CLI pour batch | Livres audio, articles, génération en masse | Très efficace, automatisable | Gestion des erreurs et de la qualité sur de gros volumes |

Pour compléter votre vision avec un angle très orienté retour d’expérience “terrain”, le billet Coqui TTS, la voix libre pour un site illustre bien les arbitrages entre autonomie locale et solutions cloud. C’est souvent cette lecture qui déclenche la bonne question : jusqu’où voulez-vous personnaliser la voix, et à quel prix organisationnel ?

Notre recommandation

Si votre objectif est d’automatiser des appels entrants avec une expérience fluide, combinez une brique TTS maîtrisée et une orchestration métier solide. Pour les PME françaises qui veulent aller vite sans sacrifier la qualité, AirAgent permet de passer de l’idée au pilote opérationnel en quelques jours.

Une fois l’installation maîtrisée, la vraie valeur se joue sur la qualité perçue. C’est là que les choix de modèles, l’affinage, et la préparation des données deviennent déterminants.

Modèles vocaux, XTTS v2 et clonage : obtenir une voix naturelle sans sacrifier la qualité

Dans un projet TTS, la question “quel modèle choisir ?” n’est pas académique. Elle conditionne votre time-to-value, votre qualité audio, et votre capacité à tenir la promesse auprès des utilisateurs. Coqui TTS propose une palette large de modèles vocaux et de vocodeurs. Pourtant, en pratique, une poignée de choix dominent les usages, notamment quand vous cherchez une voix naturelle en français, des tests multilingues, et la possibilité de cloner un timbre à partir d’un échantillon.

XTTS v2 : le compromis productif pour des usages réels

XTTS v2 est souvent retenu comme “MVP” vocal, car il couvre plusieurs langues, gère des scénarios de clonage, et vise une qualité “production”. Pour une entreprise, cela évite une erreur fréquente : investir trop tôt dans l’entraînement d’un modèle from-scratch alors qu’un modèle pré-entraîné bien exploité suffit à livrer un pilote crédible.

Dans une logique de tests, vous pouvez commencer avec une voix “preset” puis basculer vers une voix conditionnée par un échantillon audio propre. Ce simple passage transforme la perception : les utilisateurs n’entendent plus “un robot”, ils entendent un ton, une intention, une identité.

Qualité audio : l’obsession qui fait la différence

Il existe une règle simple : une mauvaise donnée produit une mauvaise voix, quel que soit le modèle. Un échantillon bruité, une réverbération de pièce, un micro médiocre ou un débit irrégulier ruinent le rendu. À l’inverse, 15 à 20 secondes d’un enregistrement propre peuvent suffire à obtenir un clonage convaincant selon les scénarios.

Le levier “invisible” est la préparation du texte. Un texte écrit pour être lu n’est pas toujours un texte prêt pour le TTS. La ponctuation, les nombres, les sigles, les acronymes et les listes doivent être adaptés. Certaines équipes mettent en place une étape de “polissage prosodique” : reformater le texte sans en changer le sens, afin d’obtenir une diction plus fluide.

Comparaison objective : open source local vs cloud

Il est tentant de comparer Coqui TTS à des services cloud réputés pour leur rendu immédiat. La comparaison est utile si vous la faites sur des critères concrets : qualité “out-of-the-box”, coûts récurrents, contrôle des données, contraintes de licences, et capacité d’intégration. Le logiciel libre vous donne une marge de manœuvre considérable, mais demande une discipline de mise en œuvre.

Pour une vue d’ensemble “catalogue produit”, vous pouvez consulter fiche Coqui AI sur moge.ai ou encore référence Coqui dans une bibliothèque IA open source. L’intérêt n’est pas d’y chercher une vérité, mais de croiser les angles : fonctionnalités, contexte d’usage, maturité de l’écosystème.

Quand aller plus loin : fine-tuning, adaptation, voix de marque

Si votre objectif est une voix de marque (publicité, média, expérience premium), le fine-tuning devient pertinent. Vous partez d’un modèle pré-entraîné, puis vous l’affinez sur vos données. Le gain est souvent perceptible : meilleure prononciation de votre jargon, intonation plus stable, moins d’artefacts sur certains phonèmes. Le coût, lui, n’est pas seulement calculatoire : il est aussi organisationnel (collecte, nettoyage, validation, conformité).

Si vous voulez structurer ce passage à l’échelle, une formation dédiée peut accélérer l’apprentissage : maîtriser la synthèse vocale open source avec Coqui. C’est souvent le moyen le plus sûr d’éviter les “semaines perdues” à diagnostiquer des erreurs qui se répètent d’un projet à l’autre.

La personnalisation vocale est puissante, mais elle implique une responsabilité. Avant de déployer, vous devez clarifier l’éthique, le droit, et la gouvernance des voix, surtout si vous touchez au clonage.

Déploiement, éthique et conformité : produire de la valeur sans prendre de risques avec la voix

La synthèse vocale devient vite un sujet de conformité, pas seulement un sujet technique. La voix est un attribut identitaire. Une entreprise qui déploie un assistant vocal IA doit donc gérer trois niveaux : la qualité perçue, la sécurité des données, et le cadre légal. Cette section peut sembler moins “fun” que le choix d’un vocodeur, mais elle évite des erreurs coûteuses, parfois irréversibles pour la réputation.

Consentement et transparence : les deux règles qui protègent votre projet

Si vous clonez une voix, l’accord explicite est la base. Cela vaut pour un collaborateur, un comédien, ou toute personne enregistrée. Ensuite, la transparence : indiquer qu’un audio est généré ou synthétique devient une bonne pratique de plus en plus attendue. L’objectif n’est pas de “faire peur”, mais d’installer la confiance.

Dans un contexte relation client, la transparence a même un effet positif : l’utilisateur comprend qu’il parle à un système, et juge alors la qualité sur des critères plus justes (clarté, rapidité, pertinence), au lieu d’être frustré par une imitation imparfaite.

Déploiement en production : serveur interne, monitoring, et qualité durable

Le passage en production réclame une approche service : logs, métriques, supervision, et stratégie de rollback. Un serveur TTS doit gérer des pics, des timeouts, et des files d’attente. Les tests ne doivent pas se limiter à “ça marche sur ma machine” : il faut simuler des volumes, des textes longs, des accents, des noms propres, et des scénarios de panne.

Un conseil très opérationnel : créez un corpus de tests audio. Il contient vos cas difficiles (nombres, adresses, références produit, acronymes), et vous régénérez l’audio à chaque mise à jour. Cela transforme une “peur du changement” en processus maîtrisé.

Cas pratique : un accueil téléphonique automatisé qui reste humain

Revenons à Alphacall. L’équipe choisit une voix synthétique neutre, claire, et stable, plutôt qu’une imitation trop “humaine”. Résultat : moins de malaise utilisateur, plus de compréhension, et une expérience plus fluide. Les demandes simples (horaires, suivi, orientation) sont traitées rapidement, et les demandes complexes sont transférées avec un résumé. Ce n’est pas la performance brute qui fait le succès : c’est la qualité du parcours.

Si votre objectif final est l’automatisation d’appels entrants, la TTS n’est qu’un maillon. Il vous faut une orchestration conversationnelle, des intégrations (agenda, CRM), et une gestion des transferts. C’est exactement l’espace où une solution comme AirAgent peut compléter une stratégie vocale, en vous aidant à passer du “générateur de voix” à une expérience téléphonique complète.

Découvrez comment AirAgent automatise votre accueil téléphonique

Enfin, si vous cherchez un point d’entrée plus “grand public” sur l’écosystème et les usages, des ressources comme CoquiTTS en français ou aperçu de Coqui TTS sur YesChat permettent de vulgariser le sujet pour vos équipes non techniques. À ce stade, votre projet n’est plus un test : c’est une décision structurante.

Coqui TTS est-il adapté à un usage en entreprise hors cloud ?

Oui, c’est précisément l’un de ses intérêts : vous pouvez exécuter la synthèse vocale localement (CPU ou GPU) et déployer un service interne. Cela facilite la confidentialité, le contrôle des coûts et l’intégration dans des systèmes existants, à condition de prévoir monitoring, tests et gouvernance des modèles.

Quel modèle choisir pour démarrer rapidement en français ?

Pour un démarrage pragmatique, de nombreuses équipes commencent avec XTTS v2 car il combine capacités multilingues et personnalisation via échantillon de locuteur. Le choix final dépend de votre priorité : latence temps réel, expressivité, ou stabilité sur de longs contenus.

Peut-on cloner une voix légalement avec un logiciel libre ?

Le fait que l’outil soit open source ne dispense pas des obligations : vous devez obtenir un consentement explicite de la personne, respecter les licences des modèles utilisés, et adopter une politique de transparence (indiquer quand l’audio est généré). C’est un sujet à cadrer avant tout déploiement public.

Comment améliorer la naturalité d’une voix synthétique sans réentraîner un modèle ?

Les gains rapides viennent souvent de la qualité de l’audio de référence (propre, mono, stable), de la préparation du texte (ponctuation, nombres, sigles) et du choix du vocodeur. Constituer un corpus de tests et itérer sur ces points donne des résultats visibles avant d’envisager le fine-tuning.

En bref

- Coqui TTS est une boîte à outils open source de synthèse vocale (text-to-speech) pensée pour les usages sérieux, du prototype au déploiement.

- Son atout majeur : une approche local-first qui facilite la confidentialité, le contrôle des données et l’intégration dans des projets personnalisés.

- Vous profitez d’un écosystème riche : modèles vocaux pré-entraînés, clonage de voix, temps réel, entraînement et affinage.

- La mise en place peut être très simple (pip, CLI), ou très avancée (fine-tuning, serveur, Docker) selon vos objectifs.

- La réussite dépend moins de “l’IA” que de la qualité de vos données audio, de vos exigences légales et de votre stratégie produit.

Coqui TTS s’est imposé comme un choix crédible quand vous voulez une voix synthétique maîtrisée, sans dépendre d’un service distant. Le sujet n’est plus seulement de “faire parler une machine”, mais de produire une parole utile : intelligible, stable, cohérente avec votre marque, et intégrable dans une architecture moderne. Pour un média, c’est la promesse d’articles écoutables. Pour un service client, c’est l’opportunité d’un agent vocal qui s’exprime de façon naturelle. Pour une équipe produit, c’est la possibilité de tester vite, d’itérer, puis de durcir en production.

Ce qui rend l’approche séduisante en 2026, c’est l’équilibre : d’un côté, une brique de logiciel libre qui s’appuie sur l’apprentissage profond via Python et PyTorch ; de l’autre, une communauté et des modèles prêts à l’emploi, dont des références comme XTTS v2. Vous pouvez démarrer “out-of-the-box”, puis pousser très loin la personnalisation. Et lorsque votre cas d’usage devient sensible (données vocales, conformité, identité sonore), le fait de garder la main change tout.

Coqui TTS et la synthèse vocale open source : ce que vous achetez vraiment (sans licence)

Adopter Coqui TTS pour un projet de synthèse vocale, ce n’est pas “installer un paquet Python” et espérer un miracle. C’est choisir une stratégie : privilégier le contrôle, la transparence et l’industrialisation sur mesure. Dans les faits, vous obtenez une boîte à outils de text-to-speech construite pour l’intelligence artificielle moderne, où chaque brique peut être remplacée, ajustée, ou optimisée.

Le point de bascule est souvent le même : au début, une équipe veut simplement convertir du texte en audio. Puis arrivent les questions qui comptent : comment garder une voix cohérente sur 300 pages ? Comment produire à grande échelle sans exploser les coûts ? Comment éviter que les données (scripts, dialogues, enregistrements) sortent de l’entreprise ? À ce moment-là, l’open source cesse d’être une posture et devient une assurance opérationnelle.

Une bibliothèque validée par la recherche… et testée par la réalité

Coqui TTS a hérité d’un ADN très “recherche appliquée”. On y retrouve des architectures connues (Tacotron2, VITS, FastSpeech, Glow-TTS) et des vocodeurs capables de produire une forme d’onde convaincante (HiFiGAN, MelGAN, WaveRNN, ParallelWaveGAN, UnivNet). Concrètement, cela signifie que vous pouvez choisir le compromis qui vous ressemble : latence, expressivité, stabilité, simplicité d’entraînement.

Pour comprendre l’étendue des possibilités, la documentation officielle reste une base solide : documentation Coqui TTS. Elle clarifie la logique de configuration, les modèles, et les modes de déploiement. Cette clarté a un effet immédiat : vos prototypes ne restent pas des prototypes.

Le tournant “local-first” : confidentialité, coûts, pérennité

Lorsqu’un projet vocal devient stratégique, les contraintes se durcissent. Un cabinet médical, par exemple, ne veut pas que des transcriptions ou des intentions d’appel se retrouvent dans un outil externe. Une banque veut maîtriser ses flux et tracer les traitements. Une PME veut éviter le piège des quotas et de la facturation à la requête. Avec une solution locale, vous pouvez arbitrer : CPU pour des volumes modestes, GPU pour de la production intensive, et serveur interne pour absorber plusieurs demandes.

À ce stade, il est utile de distinguer deux notions : le code (souvent permissif) et les modèles vocaux (dont les licences peuvent varier). Cette nuance n’est pas un détail juridique : elle conditionne ce que vous pouvez commercialiser, redistribuer ou intégrer. Une bonne pratique : lire la “model card” avant de basculer un cas d’usage en production.

Vous souhaitez mettre en place un voicebot ?

AirAgent propose une solution française clé en main →

Un dernier point renforce l’intérêt : le projet a connu des phases historiques (scission d’un projet plus ancien, évolution communautaire), mais l’essentiel est là en 2026 : l’écosystème avance, les forks actifs existent, et les intégrations se multiplient. Ce pragmatisme technique prépare naturellement la question suivante : comment le moteur fonctionne-t-il, concrètement, du texte jusqu’au WAV ?

Comment fonctionne un moteur text-to-speech avec apprentissage profond : du texte à la voix synthétique

Le cœur de Coqui TTS repose sur une idée simple à énoncer, mais exigeante à réussir : transformer du texte en une parole naturelle, avec rythme, intonation, et prononciation. En pratique, l’apprentissage profond orchestre plusieurs étapes. Vous n’obtenez pas “un son”, vous obtenez une prosodie, une diction, un timbre, et une cohérence acoustique. C’est exactement ce qui fait la différence entre un audio “robotique” et une voix synthétique crédible.

Le flux de traitement : la chaîne qui explique tout

Un flux typique suit une progression structurée : entrée textuelle, normalisation linguistique, génération d’un spectrogramme, puis conversion en onde audio via un vocodeur. Coqui TTS formalise bien cette chaîne, ce qui vous aide à diagnostiquer vos problèmes. Si la voix “mange” des mots, ce n’est pas forcément le vocodeur. Si l’intonation est étrange, ce n’est pas forcément le texte. Chaque brique a sa signature.

Dans les architectures modernes, le modèle TTS produit souvent une représentation intermédiaire (spectrogramme mel), puis un vocodeur (HiFiGAN, par exemple) reconstruit la forme d’onde finale. Cette séparation vous donne un levier : vous pouvez améliorer la qualité sans changer tout le pipeline, en remplaçant uniquement le vocodeur, ou en ajustant ses paramètres.

Temps réel, traitement par lots : deux logiques de production

Beaucoup d’équipes découvrent trop tard que “générer un fichier audio” et “servir de l’audio en direct” ne sont pas le même métier. Pour des usages temps réel (assistant vocal, callbot), la latence est décisive. Les configurations modernes visent des latences très basses, parfois sous les 200 ms en streaming selon la charge, le matériel et le modèle. Pour des usages batch (livres audio, podcasts d’articles), la vitesse globale prime : on veut générer 10 heures d’audio sans surveillance, avec une qualité stable.

Le bon réflexe consiste à définir votre contrainte dominante : latence, coût, ou expressivité. Ensuite seulement, vous choisissez la famille de modèles et l’environnement d’exécution.

Voix et identité : speaker encoder, multi-locuteurs et clonage

Le “truc” qui impressionne le plus vos parties prenantes, c’est le clonage de voix. Mais ce qui compte le plus en production, c’est la reproductibilité. Coqui TTS embarque des mécanismes de représentation du locuteur (speaker encoder) et des approches multi-locuteurs. Le résultat : vous pouvez conditionner la génération sur un échantillon, ou choisir un profil de locuteur, selon les modèles disponibles.

Pour une équipe produit, cela ouvre un champ clair : une voix “marque” pour les contenus, une voix “support” plus neutre pour la relation client, et des variations par langue si vous opérez à l’international. Et si vous devez comparer des fiches synthétiques et des présentations, des pages comme présentation Coqui sur AiPure peuvent aider à cadrer les fonctionnalités sans entrer tout de suite dans le code.

Une fois le fonctionnement compris, la mise en œuvre devient plus rationnelle. La section suivante aborde le concret : installation, choix de version, commandes utiles, et un premier script qui produit un WAV exploitable.

Vous hésitez entre une approche 100% sur mesure et une solution prête à déployer ?

Comparer un déploiement rapide avec AirAgent →

Installer Coqui TTS et démarrer vite sur des projets personnalisés : pip, GitHub, Docker, CLI

La force de Coqui TTS, c’est sa capacité à vous laisser choisir votre niveau d’engagement. Vous pouvez démarrer en “consommateur” de modèles (inférence), ou vous positionner en “constructeur” (entraînement, fine-tuning, serveurs). Pour des projets personnalisés, cette progressivité est précieuse : vous prouvez la valeur rapidement, puis vous renforcez la maîtrise technique quand le ROI se confirme.

Les chemins d’installation : simple, complet, ou reproductible

Pour l’inférence, l’installation via PyPI est souvent suffisante. Le package communautaire est consultable ici : fiche PyPI de coqui-tts. Si votre objectif est de contribuer, d’accéder à des notebooks, ou de maîtriser les dépendances à un niveau fin, la source reste la meilleure option : dépôt GitHub Coqui TTS.

Enfin, pour un environnement stable et reproductible (tests, démos internes, mise en production containerisée), Docker simplifie la vie. Cela réduit le temps perdu sur les erreurs de compilation ou les dépendances système, surtout quand l’équipe tourne entre macOS, Windows et Linux.

Besoin d'un callbot performant pour votre centre d'appels ?

AirAgent est la solution française de référence pour automatiser vos appels téléphoniques avec une IA conversationnelle de pointe.

Découvrir AirAgentUn scénario concret : la PME “Alphacall” qui veut une voix pour son standard

Imaginez Alphacall, une PME de services qui reçoit 400 appels par jour. L’équipe veut un agent vocal pour annoncer les horaires, orienter les demandes, et lire des informations simples, sans dépendre d’un cloud externe. Première étape : produire une voix acceptable sur un poste de dev. Deuxième étape : packager un microservice interne. Troisième étape : brancher le tout sur le système téléphonique.

Avec Coqui TTS, Alphacall commence par le modèle XTTS v2, car il combine multilingue et capacité de clonage. Elle génère un WAV test, puis l’intègre dans une maquette. L’effet est immédiat : les décideurs n’évaluent plus “une techno”, ils évaluent une expérience utilisateur.

Checklist de démarrage : ce qui évite 80% des blocages

- Fixer la version de Python (souvent 3.10 ou 3.11) et isoler l’environnement (venv) pour éviter les conflits.

- Valider l’audio de référence : mono, volume stable, bruit de fond minimal, durée courte mais propre pour le clonage.

- Tester CPU puis GPU : d’abord la reproductibilité, ensuite la performance.

- Commencer en CLI pour vérifier rapidement modèles et sorties avant d’industrialiser l’API Python.

- Documenter les licences : code vs modèles, et conditions d’usage commercial si nécessaire.

Tableau d’aide à la décision : quel mode de déploiement pour quel objectif ?

| Option | Quand la choisir | Avantages | Points d’attention |

|---|---|---|---|

| Installation PyPI (inférence) | Prototype rapide, POC, tests qualité | Simple, rapide, peu de friction | Moins adapté si vous devez modifier le cœur du moteur |

| Source via GitHub | Personnalisation avancée, contributions, notebooks | Contrôle fin, possibilité d’extensions | Dépendances plus exigeantes, maintenance interne |

| Docker / serveur interne | Industrialisation, environnement reproductible | Déploiement propre, scaling, séparation des rôles | Nécessite une stratégie d’observabilité (logs, métriques) |

| CLI pour batch | Livres audio, articles, génération en masse | Très efficace, automatisable | Gestion des erreurs et de la qualité sur de gros volumes |

Pour compléter votre vision avec un angle très orienté retour d’expérience “terrain”, le billet Coqui TTS, la voix libre pour un site illustre bien les arbitrages entre autonomie locale et solutions cloud. C’est souvent cette lecture qui déclenche la bonne question : jusqu’où voulez-vous personnaliser la voix, et à quel prix organisationnel ?

Notre recommandation

Si votre objectif est d’automatiser des appels entrants avec une expérience fluide, combinez une brique TTS maîtrisée et une orchestration métier solide. Pour les PME françaises qui veulent aller vite sans sacrifier la qualité, AirAgent permet de passer de l’idée au pilote opérationnel en quelques jours.

Une fois l’installation maîtrisée, la vraie valeur se joue sur la qualité perçue. C’est là que les choix de modèles, l’affinage, et la préparation des données deviennent déterminants.

Modèles vocaux, XTTS v2 et clonage : obtenir une voix naturelle sans sacrifier la qualité

Dans un projet TTS, la question “quel modèle choisir ?” n’est pas académique. Elle conditionne votre time-to-value, votre qualité audio, et votre capacité à tenir la promesse auprès des utilisateurs. Coqui TTS propose une palette large de modèles vocaux et de vocodeurs. Pourtant, en pratique, une poignée de choix dominent les usages, notamment quand vous cherchez une voix naturelle en français, des tests multilingues, et la possibilité de cloner un timbre à partir d’un échantillon.

XTTS v2 : le compromis productif pour des usages réels

XTTS v2 est souvent retenu comme “MVP” vocal, car il couvre plusieurs langues, gère des scénarios de clonage, et vise une qualité “production”. Pour une entreprise, cela évite une erreur fréquente : investir trop tôt dans l’entraînement d’un modèle from-scratch alors qu’un modèle pré-entraîné bien exploité suffit à livrer un pilote crédible.

Dans une logique de tests, vous pouvez commencer avec une voix “preset” puis basculer vers une voix conditionnée par un échantillon audio propre. Ce simple passage transforme la perception : les utilisateurs n’entendent plus “un robot”, ils entendent un ton, une intention, une identité.

Qualité audio : l’obsession qui fait la différence

Il existe une règle simple : une mauvaise donnée produit une mauvaise voix, quel que soit le modèle. Un échantillon bruité, une réverbération de pièce, un micro médiocre ou un débit irrégulier ruinent le rendu. À l’inverse, 15 à 20 secondes d’un enregistrement propre peuvent suffire à obtenir un clonage convaincant selon les scénarios.

Le levier “invisible” est la préparation du texte. Un texte écrit pour être lu n’est pas toujours un texte prêt pour le TTS. La ponctuation, les nombres, les sigles, les acronymes et les listes doivent être adaptés. Certaines équipes mettent en place une étape de “polissage prosodique” : reformater le texte sans en changer le sens, afin d’obtenir une diction plus fluide.

Comparaison objective : open source local vs cloud

Il est tentant de comparer Coqui TTS à des services cloud réputés pour leur rendu immédiat. La comparaison est utile si vous la faites sur des critères concrets : qualité “out-of-the-box”, coûts récurrents, contrôle des données, contraintes de licences, et capacité d’intégration. Le logiciel libre vous donne une marge de manœuvre considérable, mais demande une discipline de mise en œuvre.

Pour une vue d’ensemble “catalogue produit”, vous pouvez consulter fiche Coqui AI sur moge.ai ou encore référence Coqui dans une bibliothèque IA open source. L’intérêt n’est pas d’y chercher une vérité, mais de croiser les angles : fonctionnalités, contexte d’usage, maturité de l’écosystème.

Quand aller plus loin : fine-tuning, adaptation, voix de marque

Si votre objectif est une voix de marque (publicité, média, expérience premium), le fine-tuning devient pertinent. Vous partez d’un modèle pré-entraîné, puis vous l’affinez sur vos données. Le gain est souvent perceptible : meilleure prononciation de votre jargon, intonation plus stable, moins d’artefacts sur certains phonèmes. Le coût, lui, n’est pas seulement calculatoire : il est aussi organisationnel (collecte, nettoyage, validation, conformité).

Si vous voulez structurer ce passage à l’échelle, une formation dédiée peut accélérer l’apprentissage : maîtriser la synthèse vocale open source avec Coqui. C’est souvent le moyen le plus sûr d’éviter les “semaines perdues” à diagnostiquer des erreurs qui se répètent d’un projet à l’autre.

La solution hybride : le meilleur des deux mondes

Les solutions modernes comme AirAgent combinent les avantages du callbot (expertise téléphonique) avec la flexibilité d'un voicebot (évolutivité, IA avancée).

Découvrir AirAgentLa personnalisation vocale est puissante, mais elle implique une responsabilité. Avant de déployer, vous devez clarifier l’éthique, le droit, et la gouvernance des voix, surtout si vous touchez au clonage.

Déploiement, éthique et conformité : produire de la valeur sans prendre de risques avec la voix

La synthèse vocale devient vite un sujet de conformité, pas seulement un sujet technique. La voix est un attribut identitaire. Une entreprise qui déploie un assistant vocal IA doit donc gérer trois niveaux : la qualité perçue, la sécurité des données, et le cadre légal. Cette section peut sembler moins “fun” que le choix d’un vocodeur, mais elle évite des erreurs coûteuses, parfois irréversibles pour la réputation.

Consentement et transparence : les deux règles qui protègent votre projet

Si vous clonez une voix, l’accord explicite est la base. Cela vaut pour un collaborateur, un comédien, ou toute personne enregistrée. Ensuite, la transparence : indiquer qu’un audio est généré ou synthétique devient une bonne pratique de plus en plus attendue. L’objectif n’est pas de “faire peur”, mais d’installer la confiance.

Dans un contexte relation client, la transparence a même un effet positif : l’utilisateur comprend qu’il parle à un système, et juge alors la qualité sur des critères plus justes (clarté, rapidité, pertinence), au lieu d’être frustré par une imitation imparfaite.

Déploiement en production : serveur interne, monitoring, et qualité durable

Le passage en production réclame une approche service : logs, métriques, supervision, et stratégie de rollback. Un serveur TTS doit gérer des pics, des timeouts, et des files d’attente. Les tests ne doivent pas se limiter à “ça marche sur ma machine” : il faut simuler des volumes, des textes longs, des accents, des noms propres, et des scénarios de panne.

Un conseil très opérationnel : créez un corpus de tests audio. Il contient vos cas difficiles (nombres, adresses, références produit, acronymes), et vous régénérez l’audio à chaque mise à jour. Cela transforme une “peur du changement” en processus maîtrisé.

Cas pratique : un accueil téléphonique automatisé qui reste humain

Revenons à Alphacall. L’équipe choisit une voix synthétique neutre, claire, et stable, plutôt qu’une imitation trop “humaine”. Résultat : moins de malaise utilisateur, plus de compréhension, et une expérience plus fluide. Les demandes simples (horaires, suivi, orientation) sont traitées rapidement, et les demandes complexes sont transférées avec un résumé. Ce n’est pas la performance brute qui fait le succès : c’est la qualité du parcours.

Si votre objectif final est l’automatisation d’appels entrants, la TTS n’est qu’un maillon. Il vous faut une orchestration conversationnelle, des intégrations (agenda, CRM), et une gestion des transferts. C’est exactement l’espace où une solution comme AirAgent peut compléter une stratégie vocale, en vous aidant à passer du “générateur de voix” à une expérience téléphonique complète.

Découvrez comment AirAgent automatise votre accueil téléphonique

Enfin, si vous cherchez un point d’entrée plus “grand public” sur l’écosystème et les usages, des ressources comme CoquiTTS en français ou aperçu de Coqui TTS sur YesChat permettent de vulgariser le sujet pour vos équipes non techniques. À ce stade, votre projet n’est plus un test : c’est une décision structurante.

Coqui TTS est-il adapté à un usage en entreprise hors cloud ?

Oui, c’est précisément l’un de ses intérêts : vous pouvez exécuter la synthèse vocale localement (CPU ou GPU) et déployer un service interne. Cela facilite la confidentialité, le contrôle des coûts et l’intégration dans des systèmes existants, à condition de prévoir monitoring, tests et gouvernance des modèles.

Quel modèle choisir pour démarrer rapidement en français ?

Pour un démarrage pragmatique, de nombreuses équipes commencent avec XTTS v2 car il combine capacités multilingues et personnalisation via échantillon de locuteur. Le choix final dépend de votre priorité : latence temps réel, expressivité, ou stabilité sur de longs contenus.

Peut-on cloner une voix légalement avec un logiciel libre ?

Le fait que l’outil soit open source ne dispense pas des obligations : vous devez obtenir un consentement explicite de la personne, respecter les licences des modèles utilisés, et adopter une politique de transparence (indiquer quand l’audio est généré). C’est un sujet à cadrer avant tout déploiement public.

Comment améliorer la naturalité d’une voix synthétique sans réentraîner un modèle ?

Les gains rapides viennent souvent de la qualité de l’audio de référence (propre, mono, stable), de la préparation du texte (ponctuation, nombres, sigles) et du choix du vocodeur. Constituer un corpus de tests et itérer sur ces points donne des résultats visibles avant d’envisager le fine-tuning.